Китай використовує генеративні технології штучного інтелекту для ефективного створення та покращення зображень, мемів та відео з метою впливу на вибори у США

Іноземний шкідливий вплив на президентські вибори у США почався повільніше, ніж у 2016 та 2020 роках, через менш конкурентний сезон праймеріз. Зусилля Росії зосереджені на підриві підтримки України з боку США, тоді як Китай прагне скористатися соціальною поляризацією та підірвати віру у демократичні системи США. Крім того, побоювання, що складні дипфейкові відео зі штучним інтелектом зможуть успішно маніпулювати виборцями, поки що не виправдалися, але більш простий «поверхневий» фейковий контент зі штучним інтелектом і звуком, швидше за все, матиме більший успіх. Ці ідеї та аналіз містяться у другому звіті Microsoft Threat Intelligence Election Report, повідомляє Foreign Ukraine.

Росія багато вклала грошей у підрив підтримки України з боку США

За останні два місяці російські операції впливу (IO) набрали обертів. Центр аналізу загроз Microsoft відстежив щонайменше 70 російських суб’єктів, які займаються дезінформацією, орієнтованою на Україну, використовуючи традиційні та соціальні мережі, а також поєднання прихованих та публічних кампаній.

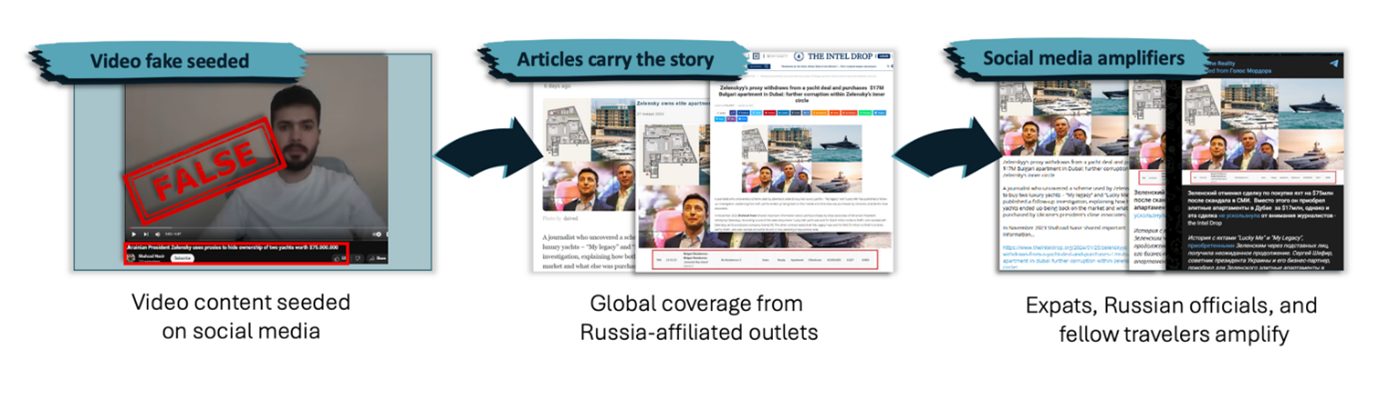

Наприклад, актор, якого Microsoft відстежує як Шторм-1516, успішно доносить до американської аудиторії антиукраїнські сюжети, використовуючи єдину схему кількома мовами. Зазвичай, ця група проходить триетапний процес:

- Людина виступає у ролі інформатора чи цивільного журналіста, поширюючи розповідь на спеціально створеному відеоканалі.

- Потім відео поширюється, здавалося б, незалежною глобальною мережею веб-сайтів, що таємно керуються.

- Потім російські емігранти, чиновники та попутники посилюють це освітлення.

- Зрештою, американська аудиторія повторює і репостить дезінформацію, ймовірно, не знаючи про її першоджерело.

Китай прагне розширити соціальні розбіжності та підірвати демократичні системи

Китай використовує багаторівневий підхід у своїй діяльності, яка орієнтована на вибори. Він отримує вигоду з існуючих соціально-політичних розбіжностей та погоджує свої атаки з партійними інтересами, щоб стимулювати органічну циркуляцію.

Масове використання Китаєм штучного інтелекту в кампаніях з впливу на вибори у США — ось чим він відрізняється від РФ. У той час як вплив штучного інтелекту в Росії продовжує розвиватися, суб’єкти, пов’язані з Китайською Народною Республікою (КНР) та Комуністичною партією Китаю (КПК), використовують генеративні технології штучного інтелекту для ефективного створення та покращення зображень, мемів та відео.

Обмежена активність далеко від Ірану, частий спойлер наприкінці гри

Зважаючи на попередню поведінку Ірану можна припустити, що він, швидше за все, розпочне активні кібероперації з впливу на вибори у США трохи пізніше. Стратегія Тегерана щодо втручання у вибори дещо відрізняється: об’єднання кібероперацій та операцій з впливу для досягнення більшого ефекту. Конфлікт, який триває на Близькому Сході, може означати, що Іран змінить свої заплановані цілі та зусилля, які спрямовані проти США.

Генеративний штучний інтелект на виборах 2024 року: ризики зберігаються, але відрізняються від очікуваних

Після демократизації генеративного штучного інтелекту наприкінці 2022 року багато хто побоювався, що ця технологія використовуватиметься для зміни результатів виборів. Microsoft працював з кількома командами над виявленням, сортуванням та аналізом зловмисного використання генеративного штучного інтелекту національними державами в операціях впливу.

Одним словом, використання високопродуктивних синтетичних дипфейкових відеороликів світових лідерів та кандидатів досі не викликало масового обману та загального збентеження. Фактично ми бачили, що аудиторія з більшою ймовірністю буде тяжіти до простих цифрових підробок і ділитися ними, які використовували впливові особи протягом останнього десятиліття. Наприклад, хибні новини із тисненими на них реальними логотипами інформаційних агенцій.

Аудиторія справді іноді захоплюється генеративним контентом штучного інтелекту, хоча успішні сценарії мають значні нюанси. Ось такі фактори сприяють генеративному ризику штучного інтелекту на виборах 2024 року:

- Контент, покращений штучним інтелектом, має більший вплив, ніж контент, повністю створений штучним інтелектом.

- Звук штучного інтелекту ефективніший, ніж відео.

- Фейковий контент, що нібито виходить із приватного середовища, наприклад телефонний дзвінок, більш ефективний, ніж фейковий контент із загальнодоступних джерел, наприклад, дипфейкове відео світового лідера.

- Поширення дезінформації стає більш дієвим за часів кризи та останніх новин.

- Уособлення менш відомих людей працює краще, ніж уособлення дуже відомих людей, таких як світові лідери.

Напередодні дня виборів у США Microsoft продовжить виявляти та аналізувати шкідливе використання генеративного штучного інтелекту та поступово оновлювати оцінку, оскільки очікується, що Росія, Іран та Китай з наближенням листопада 2024 року збільшать темпи впливу та втручання. Але якщо з метою вплинути на вибори був запущений складний дипфейк, то інструмент, використаний для маніпуляції, швидше за все, ще не вийшов на ринок. Дедалі досконаліші інструменти штучного інтелекту для відео, аудіо та зображень виходять на ринок майже щодня.