Дослідження засвідчило, що «фабрика тролів» почала експериментувати з онлайн-пропагандою та дезінформацією ще до 2013 року, орієнтуючись на міжнародну аудиторію, особливо у США, де вона втручалась у президентські вибори

«Панове, ми втручалися, втручаємось і втручатимемося… Обережно, точно, хірургічно і по-своєму, як ми вміємо. Під час наших точкових операцій ми видалимо і нирки, і печінку одночасно», – це слова архітектора російської онлайн-дезінформації Євгена Пригожина, які він виголосив у листопаді 2022 року, якраз перед проміжними виборами в США. Пригожин заснував сумнозвісну російську «фабрику тролів» (Агентство інтернет-досліджень) у 2013 році. З того часу тролі агентства наповнили платформи соціальних мереж теоріями змови та антизахідними повідомленнями, що кидають виклик основам демократичного управління. Про це йдеться в аналітичній статті Максима Маркелова, кандидата наук у сфері російських та східноєвропейських досліджень у Манчестерському університеті (Великобританія) на сторінках The Conversation, переказ якої пропонує Foreign Ukraine.

Я вивчаю твіти «фабрики тролів» англійською та російською мовами з 2021 року, зокрема, як вони спотворюють мову, щоб спотворити реальність та служити Кремлю. У моєму дослідженні було вивчено близько 3 мільйонів твітів з урахуванням трьох конкретних випадків: президентські вибори в США 2016 року, COVID-19 та анексія Криму. Здавалося, що скрізь, де був вогонь, тролі роздмухували полум’я.

Хоча їх прямий вплив на результати виборів у США поки залишається обмеженим, пропагандистські операції можуть формувати сенс онлайн-дискусій і впливати на громадське сприйняття. Але з наближенням чергових виборів у США великі технологічні компанії, такі як X (раніше Twitter), зазнають труднощів для того, щоб впоратися з інтернет-тролями, які поширюють дезінформацію у промислових масштабах.

Створення фабрики тролів

Дослідження засвідчили, що «фабрика тролів» почала експериментувати з онлайн-пропагандою та дезінформацією ще до 2013 року, найнявши невелику кількість людей, яким було доручено поширювати прокремлівські наративи та переслідувати опозиціонерів у Росії.

До 2012 року фабрика почала фокусуватися на міжнародній аудиторії, особливо у США. З того часу вона була причетна до численних кампаній щодо впливу на громадську думку в Росії та за кордоном, найбільш помітною з яких була спроба втручання у президентські вибори у США у 2016 році. Пригожин та його колеги по Фабрика тролів» пізніше підтвердили ці висновки.

«Фабрика тролів» була заснована і фінансувалась Пригожиним та спочатку базувалась у Санкт-Петербурзі. Вона працювала через кілька підставних структур, включаючи Teka та Glavset, обидві з яких були розпущені та реформовані під новими назвами, щоб фабрика могла безперешкодно продовжувати свою діяльність.

Спочатку Пригожин набув популярності як постачальник продуктів харчування для Кремля, але пізніше значно розширив свою діяльність, очоливши групу Вагнера — приватну військову компанію Росії, яка діяла в Україні та в Африці. Під час повномасштабного вторгнення в Україну, Пригожин дедалі частіше кидав виклик найвищому військовому керівництву Росії за його прорахунки під час війни в Україні.

Його доля набула рішучого оберту після короткого, але розрекламованого заколоту у червні 2023 року, коли збройні сили Вагнера рушили до Москви, зупинившись менш ніж за 200 км від столиці РФ після переговорів. У рамках врегулювання Пригожин тимчасово переїхав до Білорусі. Потім 23 серпня 2023 року літак з Пригожиним на борту зазнав аварії біля села Куженкіно, на північ від Москви, внаслідок чого загинули всі, хто знаходився на борту. Деякі джерела стверджували, що смерть Пригожина була організована Кремлем.

У процесі розширення масштабів своєї діяльності у 2014–2015 роках фабрика найняла сотні онлайн-коментаторів (тролів), які відповідали за просування та посилення наративів, що відповідають порядку денному Кремля.

За словами попередніх інформаторів, які почали проливати світло на організацію у 2015 році, більшість співробітників фабрики були молодими людьми, часто студентами, набраними через публічні оголошення про вакансії, при цьому кандидати проходили співбесіди, які включали тести на знання англійської мови та політичні знання. Заробляючи скромні зарплати у розмірі близько 40 000 рублів на місяць (приблизно 324 фунти стерлінгів або 432 долари США).

На роботі за ними велося пильне спостереження, а пізніше їх просили пройти тести на детекторі брехні, щоб довести лояльність, а ті, хто не справлявся, звільняли. Фабрика також проводила навчання, починаючи від «політичних класів», що нагадують ідеологічну обробку радянських часів, до вивчення стилів спілкування цільової аудиторії у соціальних мережах та культурних нюансів цільових товариств, щоб легко вписатися до місцевих користувачів.

Було кілька команд, кожна зі своєю регіональною і тематичною спрямованістю, які створювали підроблені персони у соціальних мережах, публікували контент, що вводить в оману, і посилювали дискусійні питання, щоб поляризувати свою цільову аудиторію. Діяльність фабрики добре фінансувалася та була високоорганізована. Співробітники працювали по 12 годин на добу, використовуючи віртуальні приватні мережі (VPN) для шифрування свого інтернет-з’єднання. Різні технології використовувалися для приховування їхнього походження та обходу заходів безпеки на платформах соціальних мереж, у які вони проникали, аби виглядати як «звичайні» користувачі.

Інформатори відкривають завісу

Інформатори пролили світло на російську «фабрику тролів», часто наражаючи себе на великий ризик. Людмила Савчук, позаштатна журналістка та колишня співробітниця фабрики, була однією з перших, хто розкрив внутрішню роботу організації. Після двох місяців «під прикриттям» вона подала до суду на фабрику за невиплату заробітної плати та відшкодування моральної шкоди, досягнувши символічного врегулювання. Її дії привернули громадську увагу до існування «фабрики тролів», розкривши її сувору ієрархію та далекосяжні плани.

Савчук описала фабрику як багатопрофільну операцію з відділами, які працюють над повідомленнями у соціальних мережах, коментують статті, створюють фейкові новини і випускають відео на YouTube. Співробітники отримували щоденні інструкції та штрафувалися за запізнення або ідеологічно невірні пости.

Марат Міндіяров, інший колишній співробітник, порівняв фабрику з в’язницею Оруелла, з тотальним контролем, який здійснюють охоронці, і постійним спостереженням. І Савчук, і Міндіяров зазначили, що більшість співробітників були мотивовані «легкими грошима», а не ідеологічною відданістю. Савчук пережила кампанію тролінгу проти неї, тоді як Міндіярова було заарештовано за хибними звинуваченнями після спілкування з американськими ЗМІ.

Незгодні голоси, такі як Савчук і Міндіяров, у сучасній Росії часто виявляються загнаними у кут під зростаючим юридичним та поліцейським тиском. Багато людей, які критикують Кремль, сприйняли смерть Олексія Навального, давнього російського борця з корупцією, у російській арктичній виправній колонії як попередження, що залишає їх перед вибором: бігти у вигнання або висловитися і заплатити високу ціну.

Усередині ехо-камери тролів

Як лінгвіст і дослідник у галузі російських та східноєвропейських досліджень, я завжди цікавився тим, як держави використовують мову в Інтернеті, намагаючись популяризувати свої програми. Але я був дійсно переконаний у необхідності детальніше вивчити цей зв’язок під час пандемії COVID-19 у 2021 році, коли онлайн-теорії змови, здавалося, раптово розцвіли. Потім, 2022 року, Росія напала на Україну, і фабрики тролів почали працювати понаднормово.

Коментарі до статей, які критикують дії Росії в Україні, були переповнені прокремлівськими ремарками, які здавалися надуманими. Я не міг повірити, що у соціальних мережах, де словесні суперечки є повсякденним явищем, користувачі одностайно вихвалятимуть позицію Кремля.

Так почався виснажливий процес аналізу твітів фабрики та зіставлення їх із твітами випадкових користувачів. Для цього я використовував набори даних «тролів» Twitter, які містять твіти з облікових записів, пов’язаних з фабрикою на основі різних «сигналів», включаючи розташування акаунту та інші облікові дані.

Я переглянув масу твітів російською та англійською мовами з 2014 по 2020 рік, шукаючи ті, які містили ключові слова, такі як «Крим», «Україна», «Росія», «Анексія» та «Політика». Потім я зібрав вибірку твітів випадкових користувачів, які використовують ті ж ключові слова та дати з Twitter. У всіх вивчених мною тематичних дослідженнях я знайшов приклади спеціалізованих повідомлень, повторної дії та хибних низових кампаній — усе це класичні пропагандистські прийоми, які були переосмислені для епохи соціальних мереж. Однак не у кожному випадку використовувалися усі три прийоми одночасно; швидше, вони застосовувалися вибірково залежно від контексту та цілей кожної кампанії.

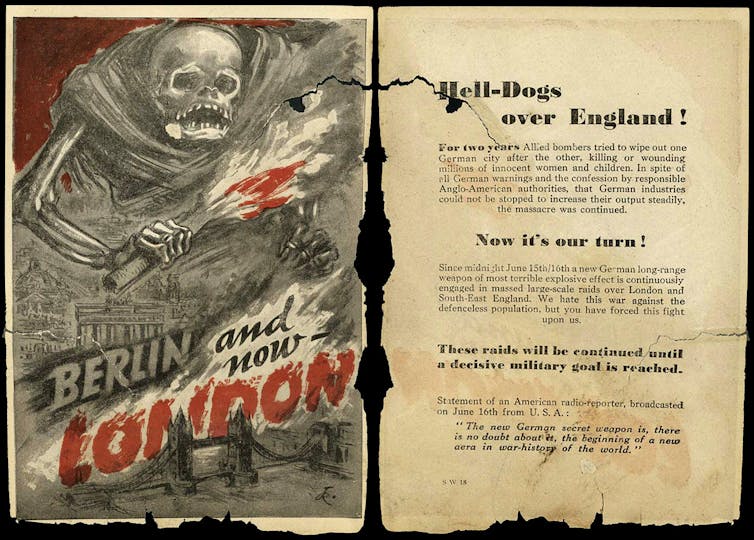

Спеціалізовані повідомлення стратегічно розробляються таким чином, щоб вони знаходили відгук у переконаннях та емоціях цільової аудиторії, як це видно на листівках часів Першої та Другої світових воєн, покликаних деморалізувати солдатів супротивника, граючи на їхніх страхах.

Повторний вплив має на увазі постійне повторення пропагандистських повідомлень для зміцнення впізнаваності та прийняття, прикладом чого служать американські теле- і радіопередачі часів холодної війни, спрямовані на протидію радянській пропаганді та вкорінення антирадянських та антикомуністичних настроїв у суспільній свідомості.

Тим часом, помилкові низові кампанії, або «астротурфінг», створюють ілюзію широкої суспільної підтримки політичної чи соціальної справи і можуть бути проілюстровані використанням Радянським Союзом підставних організацій у США, таких як Національна рада американо-радянської дружби, для поширення радянської державної пропаганди.

Ця тактика глибоко укорінена у пропагандистській теорії початку-середини ХХ століття, сформульованої такими людьми, як американський політолог і теоретик комунікацій Гарольд Лассуелл і французький соціолог Жак Еллюль.

Тролі використовували ці старі методи, щоб сприяти прийняттю надуманих поглядів Кремля всередині країни та заперечувати позиції Заходу за кордоном.

Вибори 2016 року у США

Найяскравішим випадком втручання «фабрики тролів» стали президентські вибори 2016 року у США. Вибори привернули значну увагу через суперечності навколо двох кандидатів — Дональда Трампа та Гілларі Клінтон — включаючи звинувачення у втручанні та змові Росії. Це відбувалося на тлі зростаючої стурбованості нерівністю доходів, безробіттям, расовою напруженістю, імміграцією, охороною здоров’я та зовнішньою політикою.

Незважаючи на високий інтерес до виборів та їхню ймовірну важливість, більшість виборців були незадоволені вибором кандидатів (58%) та напрямком розвитку країни (65-71% у 2016 році). «Фабрика тролів» скористалась цим, стратегічно обравши час для публікації повідомлень, щоб загострити напруженість навколо питань економіки, імміграції, права на зброю, раси, ґендеру, статі та релігійної ідентичності. Це відбивало значне занепокоєння виборців.

Моє дослідження близько 213 000 передвиборних твітів фабрики підтвердило, що тролі «грали на обидві сторони» та адаптувалися до своєї цільової аудиторії – виборців США.

Співробітники «Фабрики тролів» писали у Twitter як на користь, так і проти кандидатів. Але Трамп отримав від фабрики позитивні оцінки, особливо протягом двох років після виборів. Ставлення до Клінтон було здебільшого негативним до і під час року виборів, але різко знизилося після них. Потім тролі зосередилися на протрампівській та антитрампівській динаміці, посилюючи такі настрої, як «Зробимо Америку знову великою», а також взаємодіючи з поствиборними антитрампівськими настроями, такими як «Не мій президент».

Через два місяці після інавгурації Трампа, троль фабрики іронічно написав у Twitter: «#NeverTrump і тролі, які підтримують демократів [sic] усюди», висміюючи антитрампівські настрої у соціальних мережах.

Інший твіт фабрики критикував рішення адміністрації Трампа запровадити суворіші вимоги до роботи для отримувачів соціальної допомоги: «Трамп/Республіканська партія роблять кроки щодо вилучення продовольчих талонів у мільйонів американців. Підтримувати мільярдерів, одночасно руйнуючи найбідніших».

Ці твіти ілюструють стратегію фабрики щодо посилення розбіжностей з обох боків політичного спектру, при цьому применшуючи участь Кремля.

Але тактика фабрики вийшла за межі провокацій у соціальних мережах і включала організацію реальних подій, таких як протести та мітинги. Ці операції також були націлені на обидві сторони політичного спектру, і тролі видавали себе за політичних активістів США, щоб маніпулювати американцями, змушуючи їх організовувати та просувати заходи, створюючи таким чином неправдиву низову кампанію, яка посилювала існуючу суспільну напруженість.

Мій аналіз теми показав, що фокус тролів не був випадковим і надавав пріоритет гострим питанням, що хвилюють виборців США, таким як економіка, безпека та імміграція.

Але тролі фабрики намагалися «звучати по-американськи» риторично, їхні твіти здавалися досить нудними. У них був більш виражений ухил у бік крайнощів, вони фокусувалися на підбурювальній мові та гострих поглядах. Це не дивно, враховуючи, що складна риторика потребує повної компетентності у цільовій мові, часу та зусиль — розкіш, яку тролі не могли собі дозволити з цілодобовою роботою та суворими квотами.

Мій аналіз часових рядів також показав, що втручання тролів були стратегічними та чутливими до часу, стаючи активнішими у ключові періоди виборів. За межами цих періодів вони націлилися на вкрай праві ЗМІ за допомогою безглуздих теорій змови, таких як Pizzagate, в якій неправдиво стверджувалося про існування мереж педофілів й торговців людьми, пов’язаних із членами Демократичної партії США. Ця тактика виявилася ефективною, оскільки їхня дезінформація легко підхоплювалася і поширювалася з мінімальною зовнішньою корекцією.

Все це були приклади методів індивідуального обміну повідомленнями та астротурфінгу, що використовуються фабрикою для таргетування певної аудиторії та імітації справжнього політичного активізму. Фабрика використовувала таку саму тактику індивідуального обміну повідомленнями і навіть більше під час пандемії.

COVID-19

Початковий період пандемії був відзначений страхом і невизначеністю, що створило благодатний ґрунт для поширення тролями дезінформації й теорій змови, експлуатуючи занепокоєння людей та посилюючи замішання.

У 2020 році твіти фабрики про COVID-19 просували брехню про вірус, його походження та заходи сектору охорони здоров’я. Вони стратегічно уникали поширення повідомлень про важливі заходи сектору охорони здоров’я та профілактики. Натомість, зосередилися на теоріях змови, таких як «COVID-19 як біологічна зброя США», стверджуючи, що Сполучені Штати створили вірус у секретній військовій лабораторії та їх інтерпретації змови «Великого перезавантаження».

Агенти фабрики також прагнули підірвати зусилля сектору охорони здоров’я, експлуатуючи технологічні тривоги та критикуючи неоліберальну економічну політику.

«США близькі до впровадження системи масового спостереження на основі штучного інтелекту під виглядом боротьби з коронавірусом», – написав троль у Twitter, натякаючи на надмірне втручання уряду США.

Дивно, але тролі використовували слово «авторитарний» як самоопис, порівнюючи «ефективну» реакцію на COVID-19 в авторитарних режимах, таких як Росія чи Китай, зі «слабкою» і «некомпетентною» на Заході.

Це знаменувало відхід від історичної російської пропаганди, яка зображала Росію як «справжню демократію» проти західних демократій з «правлінням меншості». Зображуючи сучасні автократії як ефективніші в управлінні кризами, фабрика поставила під сумнів ефективність демократичного управління під час криз, прагнучи поглибити недовіру до західних інститутів та просувати прокремлівські наративи.

Залучення тролів до теорії змови охоплювало вкрай праві (QAnon, «злі еліти», що маніпулюють громадськістю) і вкрай ліві (The Grayzone, уряд США використовує COVID-19 для отримання прибутку) маргінальні спільноти, а також загальні проблеми по всьому політичному спектру, такі як вторгнення держави у приватне життя та підрив громадянських свобод. Це виявило опортуністичний, багатошаровий підхід.

Для російськомовної аудиторії тролі применшували серйозність пандемії коронавірусу вдома, зосередившись на ймовірних невдачах Заходу, підкреслюючи економічну стійкість Росії та уникаючи пов’язаних зі здоров’ям термінів, як-от інфекція і профілактика. У той же час активно пропагувалась теорія змови про «вірус із лабораторії США», що зміщує фокус із внутрішніх проблем за допомогою «whataboutism» епохи холодної війни.

Деякі з їхніх російських твітів намагалися бути гумористичними та саркастичними, висміюючи власну реакцію Росії на COVID-19 за допомогою мемів, іронії та сарказму, щоб наголосити на неефективності. Як і в їх англійських твітах, які використовували існуючі теорії змови, що циркулюють у маргінальних західних спільнотах, мета, ймовірно, полягала у тому, щоб приховати причетність фабрики до операції.

Знову ж таки, це були приклади спеціально підібраних повідомлень та методів повторного впливу, що використовуються фабрикою для експлуатації страхів та невизначеності навколо COVID-19, при цьому послідовно просуваючи брехню, наприклад, що COVID-19 є біологічною зброєю, створеною в США.

Крим

Зрозуміло, як тактика тролів змінювалася з роками. Я розпочав свій аналіз із вторгнення до Криму на початку 2014 року — часу, коли Twitter та інші платформи соціальних мереж були ще відносно молоді. Тоді здавалося, що тролі більше переймаються використанням класичних історичних стежок для поширення своєї брехні.

Після масових протестів у Києві та повалення президента Віктора Януковича, російські солдати захопили контроль над Кримом. Пізніше парламент регіону проголосив незалежність від України та був проведений спірний референдум про приєднання до Росії. Окупанти повідомили, що близько 97% кримчан проголосували за приєднання до Росії, але референдум був засуджений на міжнародному рівні як незаконний.

Дехто в Росії засумнівався в офіційних результатах, заявивши про фальсифікацію виборів. Незважаючи на численні санкції, запроваджені Заходом, Росія зберегла контроль над Кримським півостровом.

Для англомовної аудиторії співробітники фабрики використовували евфемізми (м’які терміни для чогось різкого) та дисфемізми (жорсткі терміни для чогось м’якого) для формування наративу. Наприклад, «повернення додому» (евфемізм) замість «анексії» чи «неонацистський режим» (дисфемізм) замість «українського уряду».

Вони представили анексію як «возз’єднання» та «відновлення історичної справедливості» для Росії, водночас зображуючи Україну як «неонацистський режим» під західним впливом. Ця мова була спрямована на підрив суверенітету України та просування порядку денного Кремля. За кілька тижнів до кримського референдуму троль опублікував повідомлення «Севастополь сумує за матір’ю #Росією».

«Західні держави підтримують неонацистський переворот в Україні», – написав троль у Твіттері у лютому 2014 року, вторячи російській державній пропаганді про повалення прокремлівського президента Януковича. Інший троль агентства у січні 2015 року заявив: «Обама має припинити підтримувати нацистів в Україні!» після того, як президент США засудив анексію Криму та запровадив санкції проти Росії.

Для російськомовних такі терміни, як «повернення до рідної гавані» та «відновлення історичної справедливості», використовувалися, щоб викликати почуття історичної спадкоємності та легітимності, показуючи анексію як законне виправлення.

До 2015 року тролі фабрики почали асоціювати «Україну» з емоційно зарядженими термінами, такими як «криза» та «небезпека», а до 2017 року — з термінами, такими як «нацисти» й «терористи». Ці стратегічні рішення були спрямовані на те, щоб вплинути на негативне сприйняття України, приховуючи одночасно реальність анексії Росією.

«Фабрика тролів» навіть публікувала твіти, які мали явно антикремлівську позицію, оскільки хотіли не лише викликати взаємодію, але й поляризувати та заплутати свою цільову аудиторію.

Для росіян вони провели кордон між «російською» та «українською ідентичністю». Наприклад, російське слово «возз’єднання» масово використовувалося для позначення добровільного та взаємного повернення Криму до складу Росії, викликаючи історичні асоціації з такими подіями, як Переяславський собор — угода 1654 року, за якою Україна шукала військовий захист у Росії. Історично це розглядалося Росією як «возз’єднання», щоб наголосити на легітимності та спадкоємності її претензій на Україну.

Ці спроби переосмислення тривали з 2014 до 2017 року, посилюючись навколо ключових політичних подій. У російськомовному контексті використання пропагандистських штампів тролями фабрики набагато перевершувало випадкових користувачів Twitter, які часто використовували ці терміни іронічно.

Незважаючи на скептицизм звичайних користувачів, фабрика послідовно дотримувалась програми Кремля. Це ще раз ілюструє роль повторного викриття як тактики державної пропаганди, що сприяє прийняттю навіть найнадуманіших тверджень державної пропаганди.

«Фабрика тролів» та розвідувальні служби Росії

Багато людей на Заході розглядають державний апарат Росії як монолітну структуру, в якій державні чиновники отримують прямі накази з Кремля. Проте дослідники підкреслюють хаос і роздробленість усередині, оскільки розвідувальні агентства, такі як ФСБ (Федеральна служба безпеки), ГРУ (Головне розвідувальне управління) та СЗР (Служба зовнішньої розвідки), часто мають суперечливі ролі та операції, що перетинаються.

Приватні підрядники, такі як «Фабрика тролів», здаються центральними фігурами інтернет-тролінгів, але є частиною зусиль з підриву.

Кремль може встановлювати порядок денний цих операцій, але детальна координація і «генеральний план» – малоймовірні. Однак результат, зазвичай, виявляється на користь Кремля. Якщо операція створює досить плутанини та безладдя — навіть якщо в ній звинувачують Кремль — вона може підвищити свій імідж як сильного гравця з великим охопленням.

У цьому «інформаційному безладді» для перемоги над державними тролями необхідно зіткнутися з протверезною реальністю: як державні, так і недержавні суб’єкти дедалі частіше займаються організованою дезінформацією у соціальних мережах, тоді як платформи важко справляються з цією проблемою — незважаючи на наявність технологій для цього, включаючи повідомлення користувачів та модерацію, інструменти прозорості контенту та сторонній огляд контенту.

Хоча багато людей вважають Росію яскравим прикладом онлайн-дезінформації й тролінгу, що спонсорується державою, до неї приєдналися десятки інших країн, зокрема кілька на Заході. У 2020 році дослідники Оксфордського університету виявили 81 країну, які використовували соціальні мережі для поширення пропаганди та дезінформації.

Ключова відмінність полягає у ступені участі держави та масштабі цільових країн. У багатьох західних країнах ці зусилля мають спорадичний характер і очолюються політиками, політичними партіями, приватними підрядниками та впливовими особами, націленими на внутрішню аудиторію. Навпаки, кампанії Росії є наполегливими, централізованішими і націлені на багато зарубіжних країн.

Хоча Росія розробила складний підхід до дезінформації та пропаганди, багато в чому вона діяла як учень, а не новатор, адаптуючи та контекстуалізуючи існуючі методи, маючи при цьому оперативну свободу через відсутність підзвітності порівняно з ліберальними демократіями.

Одним із яскравих прикладів використання цифрових авторитарних методів на Заході є антивакцинальна кампанія збройних сил США з підриву китайської вакцини Sinovac, яка розпочалась за президента Трампа і тривала кілька місяців після інавгурації Джо Байдена. Як і тролі фабрики, ця кампанія використовувала сотні облікових акаунтів соціальних мереж, щоб видавати себе за користувачів в інших країнах, націлених на Південно-Східну Азію, Центральну Азію та Близький Схід.

Це аж ніяк не виправдовує систематичні та широкомасштабні операції Росії з тролінгу проти політичних опонентів та демократичних інституцій, але викликає побоювання з приводу цифрової прозорості та довіри до сучасних демократій.

Незважаючи на поінформованість, розвиток технологій і адаптивність дезінформації, що підтримується державою, ця загроза навряд чи скоро зменшиться. Підробляти активність та залученість користувачів у соціальних мережах стає простіше та швидше.

Такі платформи, як X, часто обмежують видимість зловмисного контенту замість того, щоб видаляти його, тому фальшиві акаунти можуть не бути швидко забанені. Навіть коли на них надходять скарги, платформи часто роблять мінімальні дії.

Для вирішення цієї складної та постійної проблеми необхідно більше прозорості, постійна пильність з боку користувачів та засобів масової інформації, а також своєчасні дії з боку великих технологічних платформ.

Штучний інтелект та новий лідер тролів

За повідомленнями, за кілька місяців після смерті Пригожина його «фабрика тролів» продовжувала активно просувати прокремлівські погляди на повномасштабне вторгнення в Україну. Неясно, хто працює в останній версії російської фабрики тролів, оскільки, вона тепер дуже роздроблена і складається з кількох організацій, кожна з яких має свої власні критерії найму.

Особа нового лідера тролів також незрозуміла. Але є припущення про участь російської розвідки та Кремля. Ці зусилля в першу чергу спрямовані на підтримку України, в них задіяні десятки тролів і перекладачів,. Ілля Гамбашидзе, політичний стратег із Москви часто згадується як «наступник Пригожина».

У процесі розвитку технологій штучного інтелекту, дезінформація, що спонсорується державою, ймовірно, буде використовувати складніші методи генерації та поширення контенту. OpenAI, творець ChatGPT, нещодавно розкрив дві таємні операції з впливу Росії. Ці операції використовували інструменти OpenAI для генерації контенту у соціальних мережах — переважно короткі політичні коментарі — кількома мовами на таких платформах, як X і Facebook. OpenAI стверджує, що виявила та припинила ці операції поки вони не стали вірусними.

Хоча штучний інтелект нібито підвищив продуктивність цих операцій, вони, як і раніше, схильні до людських помилок, таких як публікація повідомлень, що розкривають використання певної моделі штучного інтелекту.

На початку вересня 2024 року Міністерство юстиції США повідомило про зрив таємної операції, спонсорованої російською державою, яка використовувала підроблені веб-сайти та профілі у соціальних мережах для поширення дезінформації, створеної штучним інтелектом. Ця дезінформація, яка була спрямована на підтримку України, просувала прокремлівські наративи та намагалася вплинути на виборців США напередодні президентських виборів 2024 року.

Ця тенденція викликає занепокоєння. Використання штучного інтелекту для створення реалістичного фейкового контенту у поєднанні із передовою аналітикою даних для націлення на певну аудиторію, створить значні проблеми для зусиль, спрямованих на протидію дезінформації.